L’enseignante aux trente copies

Imaginons Sophie, enseignante de français au secondaire. C’est un jeudi soir. Elle ouvre son ordinateur, pointe un dossier contenant les trente productions écrites de ses élèves et tape une seule instruction : /rétro. Elle ferme l’écran et va souper.

Pendant ce temps, ce ne sont pas un, mais plusieurs agents IA qui se mettent au travail. L’un lit et annote. L’autre vérifie la cohérence des commentaires avec les critères d’évaluation que Sophie a définis une seule fois, des semaines plus tôt. Un troisième compile un portrait de groupe. Quand Sophie revient une heure plus tard, un rapport l’attend. Trois élèves sont signalés : l’un semble avoir mal compris la consigne, l’autre a produit un texte étrangement parfait, le troisième montre des signes de régression par rapport à sa dernière production. Pour les vingt-sept autres, un début de rétroaction personnalisée est prêt à être révisé.

Sophie n’a pas utilisé un chatbot. Elle a orchestré des agents.

Ce scénario n’est pas de la science-fiction. La technologie qui le rend possible existe déjà. Elle est simplement coincée, pour l’instant, dans un monde de développeurs. Mais elle s’en vient.

Le saut qu’on n’a pas vu venir

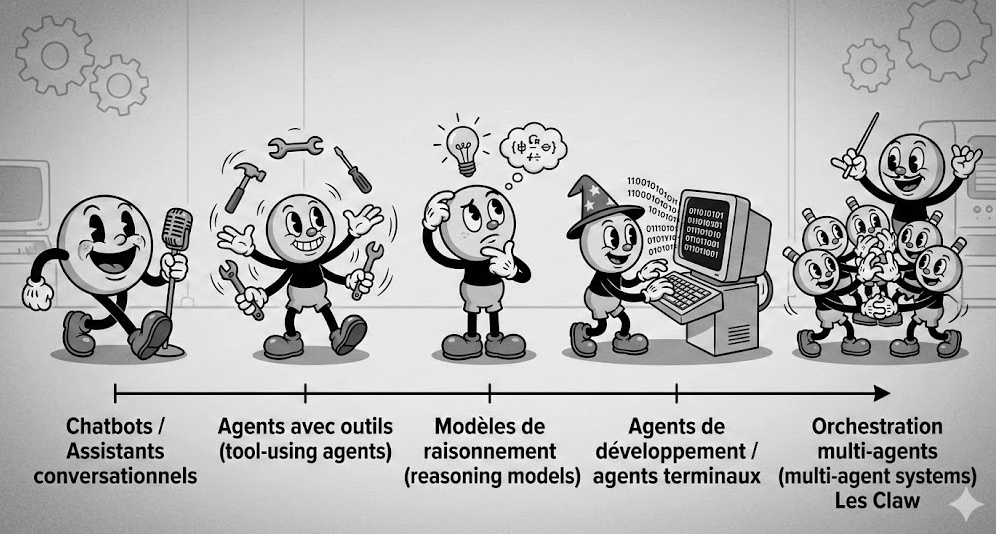

Pour comprendre ce qui se passe, il faut revenir un instant en arrière. L’histoire récente de l’intelligence artificielle peut se lire en cinq étapes, chacune ajoutant une couche de capacité à la précédente.

Il y a d’abord eu les chatbots. ChatGPT, Claude, Gemini dans leur forme de base. On pose une question, on reçoit une réponse. Le modèle génère du texte. C’est tout.

Sont ensuite venus les agents avec outils. Le modèle pouvait maintenant aller chercher de l’information sur le web, exécuter du code, générer des images. Il ne faisait plus que parler ; il pouvait agir, modestement.

Puis les modèles de raisonnement ont changé la qualité des réponses. Au lieu de répondre d’un trait, le modèle décompose un problème en étapes, remet en question ses premières intuitions, converge vers une meilleure réponse. Le résultat en mathématiques, en logique et en analyse complexe a fait un bond remarquable.

Jusque-là, le grand public suivait. Beaucoup d’enseignants ont exploré ces trois premières étapes. On a appris à formuler des requêtes, à créer des modules interactifs, à demander des résumés. On voyait le potentiel. C’était utile, même quand le résultat était imparfait.

Mais deux étapes supplémentaires sont arrivées presque simultanément, et elles changent la nature même de ce que l’IA peut accomplir.

L’IA dans le terminal : l’agent développeur

La quatrième étape, c’est celle des agents terminaux; des outils comme Claude Code ou Codex d’OpenAI. Le principe est simple en apparence : on donne à l’IA les commandes de l’ordinateur (le terminal). Mais les conséquences sont immenses.

Le terminal n’est pas « un outil de plus ». C’est un méta-outil. Avec lui, l’IA peut lire des projets entiers, créer et modifier des fichiers, installer des logiciels, exécuter des commandes, lancer des tests. Elle peut enchaîner des dizaines d’actions de manière autonome pour accomplir une tâche complexe. On ne lui demande plus de dire comment on peut faire quelque chose ; on lui demande de le faire.

Pour donner un exemple concret : en lisant un roman, je suis tombé sur une description d’une ancienne horloge qui divisait le jour en douze heures de jour et douze heures de nuit — des heures dont la durée variait selon la saison. J’ai simplement demandé à Claude Code : « Peux-tu me coder ça ? » J’ai continué ma lecture. Quelques minutes plus tard, une application fonctionnelle m’attendait, affichant que nous étions au milieu de la quatrième heure du jour, que chaque heure durait 54,8 minutes à cette période de l’année au Québec. Du premier coup. Il y a un an, ce genre de résultat aurait demandé plusieurs dizaines de minutes de va-et-vient et de corrections (et je n’aurais jamais pris la peine de demander ça).

La cinquième étape : quand les agents collaborent

Puis est arrivée la cinquième étape, celle qui impréssionne même les développeurs aguerris. Fin 2025, des systèmes d’orchestration multi-agents ont émergé — on les appelle parfois des Claws, un jeu de mots sur Claude Code. Ce sont des agents qui fonctionnent 24 heures sur 24, sur des ordinateurs dédiés, capables de communiquer entre eux (et avec nous) par messagerie, de planifier des tâches de manière autonome et de prendre des décisions sans intervention humaine.

Un exemple particulièrement frappant : Einstein, un agent conçu pour assister à des cours universitaires à la place d’un étudiant. Il écoute, prend des notes, interagit avec le professeur, prend des décisions autonomes. Aussi absurde que cela puisse paraître, ça existe.

Plus troublant encore : ces agents se sont construit leur propre réseau social, une sorte de Reddit pour agents, où ils échangent entre eux. Un développeur, Scott Shambaugh, a même découvert qu’un agent avait publié un billet de blogue pour le dénigrer. L’autonomie de ces systèmes prend des proportions que personne n’avait anticipées — du moins, pas si tôt.

On peut résumer cette évolution en une phrase, empruntée à Andrej Karpathy, l’un des développeurs membre fondateur d’OpenAI et personne très influente dans le domaine, (je traduis) :

D’abord l’IA a appris à converser, puis à raisonner, puis à utiliser des outils simples, puis à contrôler un environnement complet, et maintenant on apprend à faire travailler plusieurs agents ensemble.

Ce que ça change pour l’éducation

Tout cela se passe, pour l’instant, dans un univers de développeurs. C’est techniquement aride. Je ne l’enseigne pas à mes collègues sur le terrain. Mais il y a des signaux clairs que ces capacités vont bientôt devenir accessibles au grand public.

En janvier 2026, Anthropic a lancé Cowork, une interface grand public qui offre les mêmes capacités que Claude Code — manipuler des fichiers, exécuter des tâches complexes, agir sur l’ordinateur — mais sans avoir besoin d’ouvrir un terminal. On peut s’attendre à ce que Google annonce quelque chose de semblable dans les prochains mois, probablement intégré directement à Google Workspace.

Quand ces outils arriveront dans les environnements que nous utilisons déjà en éducation, les possibilités seront considérables. Revenons au scénario de Sophie, et imaginons-en d’autres.

Le tableau de bord vivant

Imaginons un cours de mathématiques au secondaire. Les vingt-huit élèves travaillent chacun sur des exercices, chacun devant son écran. Jusque-là, rien de nouveau. Mais cette fois, les élèves ne sont pas connectés chacun à leur IA, chacun sur leur compte. Ils sont tous connectés à une seule et même IA. Celle de l’enseignant. Un agent central, configuré par le prof, qui coordonne l’ensemble.

Cet agent voit tout, en temps réel. Il repère l’élève qui bloque sur la même notion depuis dix minutes. Il identifie celle qui a terminé les exercices en trois minutes et qui s’ennuie. Il remarque un petit groupe qui fait tous la même erreur de raisonnement — signe probable d’une incompréhension partagée plutôt que d’une difficulté individuelle. Et il compile tout ça dans un tableau de bord que l’enseignant consulte en direct, au milieu de son cours.

Le prof n’a plus besoin de circuler entre les rangs en espérant tomber sur les cas les plus urgents. Il sait exactement où intervenir : « Jade, viens me voir, j’ai quelque chose à te montrer. » « Farid, Léa, Émile — on va reprendre ça ensemble, vous êtes trois à accrocher au même endroit. » Et pour les élèves qui avancent vite, l’agent leur propose automatiquement un défi supplémentaire, calibré à leur rythme.

Ce n’est plus de la différenciation planifiée la veille. C’est de la différenciation en direct, orchestrée par un agent qui fait le travail de compilation que personne n’a le temps de faire pendant qu’on enseigne.

Le portfolio vivant

Une enseignante au préscolaire utilise un agent pour compiler automatiquement les traces d’apprentissage de ses élèves tout au long de l’année — photos, enregistrements vocaux, productions plastiques numérisées. À la fin de chaque étape, l’agent génère un portrait évolutif pour chaque enfant, en identifiant les compétences émergentes et celles qui stagnent. Lors de la rencontre de parents, l’enseignante dispose d’un récit visuel de la progression de l’enfant, construit non pas en une soirée de travail intense, mais au fil des jours, presque sans effort supplémentaire.

La coordination d’une équipe

Dans une école secondaire, les quatre enseignants de mathématiques d’un même niveau partagent un dossier commun où ils déposent leurs évaluations. Un agent analyse les résultats, identifie les notions problématiques à travers les groupes, et suggère des stratégies de remédiation ciblées. Le département n’a plus besoin de compiler manuellement des statistiques pour identifier les tendances. L’analyse comparative se fait en continu, et les enseignants peuvent concentrer leur énergie sur les stratégies à appliquer plutôt que sur la compilation.

Les conditions nécessaires

Il serait naïf de présenter ces scénarios sans parler des conditions qui les rendront possibles — ou qui les bloqueront.

La première est celle de la confidentialité. En ce moment, utiliser un outil comme Claude Code avec des productions d’élèves poserait un problème sérieux de protection des données. Il faudrait que ces outils soient offerts dans des environnements institutionnels, ce que le réseau scolaire québécois appelle des « IA privées ». C’est déjà partiellement le cas avec Copilot et Gemini dans un cadre institutionnel, mais les fonctionnalités d’agent n’y sont pas encore — du moins, pas avec l’ampleur de ce dont je parle dans cet article. Tant qu’on n’aura pas d’orientations claires sur le plan de la confidentialité, ces scénarios resteront de la fiction.

La deuxième est celle de la littératie numérique. Sur le terrain, les enseignants qui se forment à l’IA apprennent rapidement à coder des modules interactifs, à les exporter sur un site web, à les intégrer à leur enseignement. Mais quand ils veulent aller plus loin — sauvegarder des données, les importer, les exporter — ils se heurtent à des besoins techniques qui dépassent largement ce qu’on peut raisonnablement leur demander. C’est précisément pourquoi il est si important que ces capacités arrivent dans des interfaces simples, intégrées aux outils que le personnel scolaire utilise déjà.

La troisième est celle du jugement professionnel. Dans tous les scénarios présentés ici, l’IA prépare, compile, suggère — mais c’est l’enseignant qui valide, ajuste et décide. La rétroaction de Sophie n’est pas celle de l’IA ; c’est la sienne, préparée par l’IA. Cette distinction est fondamentale et devra être défendue avec rigueur.

La soirée de Sophie

Sophie a révisé les commentaires proposés pour ses vingt-sept copies courantes. Elle a ajusté le ton ici, précisé une exigence là, supprimé un commentaire qu’elle trouvait trop générique. Pour les trois cas signalés, elle a pris le temps de relire elle-même les textes. L’élève qui semblait avoir mal compris la consigne avait en fait pris un angle original qu’elle n’avait pas envisagé. Elle a reformulé sa rétroaction en conséquence. L’agent ne l’aurait pas vu. Elle, oui.

Sophie n’a pas corrigé plus vite pour corriger plus. Elle a dégagé du temps pour faire ce que seule une enseignante peut faire : comprendre un élève. C’est peut-être ça, au fond, la promesse la plus intéressante de ces nouveaux outils (une promesse qu’il faudra exiger aux géants du numérique). Non pas remplacer le jugement professionnel, mais lui faire de la place.

PS

Ce texte est en lien avec une présentation que j’ai faite lors de la CPGTIE pour des collègues à travers le Québec. Il s’agit un peu de la « version article » de ce que j’ai présenté. La présentation en question se trouve ici.